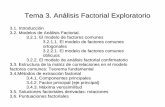

Tema 2.- Regresión lineal múltiple (I). 2.4 ...personal.us.es/analopez/rlm.pdf ·...

Transcript of Tema 2.- Regresión lineal múltiple (I). 2.4 ...personal.us.es/analopez/rlm.pdf ·...

Tema 2.- Regresión lineal múltiple (I). 2.1. Introducción2.2. Especificación del modelo de regresión lineal múltiple. 2.3. Estimación de los parámetros del modelo por mínimos cuadrados. 2.4. Interpretación de la ecuación de regresión. 2.5. Contraste de la regresión

2.5.1. Componentes de variación.2.5.2. Bondad de ajuste.2.5.3. Validación del modelo.2.5.4. Significación de parámetros.

2.6. Predicción. 2.7. Estimación paso a paso: Correlación semiparcial.2.8. Términos de interacción en el modelo de regresión.

2.1. Introducción

La necesidad de ampliar el modelo de regresión simple incluyendo nuevas variables predictoras obedece a dos razones fundamentales:

Dar cuenta de la complejidad de la conductaAumentar la potencia de los contrastes de la regresión

2.2.Especificación del modelo de RLM2.2.1.Estructura básica del modelo

X1

Y εX2

X3

Xk

Como en la regresión simple las variables predictoras o independientes pueden ser cuantitativas o cualitativas

2.2.Especificación del modelo de RLM

Deseamos estudiar la relación entre síntomas de estrés, años trabajados y salario. En este caso las variables predictoras son cuantitativas. Deseamos estudiar la relación entre cansancio emocional, el sexo y el tipo de contrato laboral distinguiéndose entre contrato indefinido y temporal.Deseamos estudiar la relación entre sobrecarga en el trabajo, falta de recursos, sexo y tipo de contrato distinguiéndose para la variable tipo de contrato los siguientes funcionario, laboral indefinido y temporal.

Expresión matemática del modelo en la población

( )Y f X X X X Y

Y X X X

Y Y

i ij i i i k ik i i i

i i i k ik

i i i

= + = + + + + = +

= + + +

= −

ε β β β β ε ε

β β β β

ε

0 1 1 2 2

0 1 1 2 2

... $

$ ...$

YYYY

X X XX X XX X XX X XN

K

K

K

N N NK K N

1

2

3

11 12 1

21 22 2

31 32 3

1 2

0

1

3

1

2

3

1111

⎛

⎝

⎜⎜⎜⎜

⎞

⎠

⎟⎟⎟⎟=

⎛

⎝

⎜⎜⎜⎜

⎞

⎠

⎟⎟⎟⎟

⎛

⎝

⎜⎜⎜⎜

⎞

⎠

⎟⎟⎟⎟+

⎛

⎝

⎜⎜⎜⎜

⎞

⎠

⎟⎟⎟⎟

ββββ

εεεε

Y XB e= +

Hipótesis básicas del modelo de RLM

1. El término de Error es una variable aleatoria con media cero

2. Homocedasticidad: la varianza del término de error es constante

3. Los errores son independientes entre sí.

4. Los errores se distribuyen normalmente

5. Las variables predictoras no pueden correlacionar de manera perfecta

Resumen gráfico de las hipótesis básicas formuladas en términos de la variable criterio

Criterio de mínimos cuadrados:

2.3.1. La ecuación de regresión de mínimos cuadrados en puntuaciones directas y principales propiedades

2.3. Estimación de los parámetros del modelo de RLM

Y b b X b X b X e Y e

Y b b X b X b X

e Y Y

i i i k ik i i i

i i i k ik

i i i

= + + + + = +

= + + +

= −

0 1 1 2 2

0 1 1 2 2

... $

$ ...$

( ) ( )( )

( ) ( )

e Y Y Y b b X b X b Xii

N

i i i i i k iki

N

i

N2

1

2

0 1 1 2 22

11

= − = − + + + + =

=

= ==

−

∑ ∑∑ $ ... min

b X' X X' Y1

Propiedades de la ecuación de regresión de mínimos cuadrados

1) La media de las puntuaciones predichas es igual a la media de Y2) Los errores tienen media cero3) La ecuación de regresión de mínimos cuadrados para por el centro de la nube de puntos:

4) Los errores no correlacionan ni con las variable predictorasni con las puntuaciones predichas

( )X X X YK1 2, ,... ,

( )b Y b X b X b XK K0 1 1 2 2= − + + +...

2.4. Interpretación de la ecuación de regresión.

Ejemplo:

Nivel de desarrollo a los 6 años

Estimulación paterna

Nivel de desarrollo a los 3 años

Estimulación materna 0,48

0,01

0,62

$ , , , ,Y X X Xi = + + +20 80 0 48 0 01 0 621 2 3

2.4. Interpretación de la ecuación de regresión.

Coeficientesa

3,611 ,718 5,027 ,000-,051 ,017 -,139 -3,044 ,003,149 ,012 ,582 12,752 ,000

(Constante)Realización personCansancio emocion

Modelo1

B Error típ.

Coeficientes noestandarizados

Beta

Coeficientesestandarizad

ost Sig.

Variable dependiente: emesttotala.

CERPy ×+×−= 149,0051,0611,3ˆ

2.4. Interpretación de la ecuación de regresión.

y = 0,157x + 1,987

y = 0,157x + 1,287

cansancio emocional

sint

omas

de

estr

és

mujerhombre

Coeficientesa

1,987 ,292 6,812 ,000,157 ,011 ,614 14,001 ,000

-,700 ,248 -,124 -2,820 ,005

(Constante)Cansancio emocSexo

Modelo1

B Error típ.

Coeficientes noestandarizados

Beta

Coeficientesestandarizad

ost Sig.

Variable dependiente: emesttotala.

Sexo

142173315

,00 Mujer1,00 HomTotal

VálidosFrecuencia

( ) CEySexobreslosParaCEy

SexomujereslasParaSEXOCEy

×+−==

×+==

×−×+=

157,0700,0987,1ˆ1hom

157,0987,1ˆ0

700,0157,0987,1ˆ

2.4. Interpretación de la ecuación de regresión.Coeficientesa

5,206 ,281 18,509 ,000-,915 ,328 -,162 -2,787 ,006-,096 ,336 -,017 -,285 ,776

(ConstanSexoPersona

Mode1

B Error típ.

Coeficientes noestandarizados

Beta

Coeficientestandariza

ost Sig.

Variable dependiente: emesttotala.

Personal

122193315

,00 PAS1,00 PDITotal

VálidosFrecuencia

096,0915,0206,51096,01915,0206,5ˆhom

915,0206,50096,01915,0206,5ˆhom

096,0206,51096,00915,0206,5ˆ

206,50096,00915,0206,5ˆ

096,0915,0206,5ˆ

−−=×−×−=

−=×−×−=

−=×−×−=

=×−×−=

×−×−=

yPDIdelbreslosPara

yPASdelbreslosPara

yPDIdelmujereslasPara

yPASdelmujereslasPara

PERSONALSEXOy

Sexo

142173315

,00 Mujer1,00 HomTotal

VálidosFrecuencia

ecuación de regresión en diferenciales

$ ...y b x b x b xi i i k ik= + + +1 1 2 2

ecuación de regresión en estandarizadas

β j jj

y

bSS

=

$ ...Z Z Z Zyi i i k ik= + + +β β β1 1 2 2

Relación entre bj y βj regresión en estandarizadas

2.5. Contraste de la regresión2.5.1. Componentes de variación.2.5.2. Bondad de ajuste.2.5.3. Validación del modelo.2.5.4. Significación de parámetros.

2.5.1. Componentes de variación.

( ) ( ) ( )Y Y Y Y Y Y

SC SC SC

ii

N

ii

N

i ii

N

t res

− = − + −

= += = =∑ ∑ ∑

2

1

2

1

2

1

$ $

exp

2.5.2. Bondad de ajuste.

( )( )

RSCSC

Y Y

Y Yy k

t

ii

N

ii

N. , ,..,exp

$

1 22

2

1

2

1

= =−

−

=

=

∑

∑

Y X2X1

r12= 0

2.5.2. Bondad de ajuste.

( )( )

RSCSC

Y Y

Y Yy k

t

ii

N

ii

N. , ,..,exp

$

1 22

2

1

2

1

= =−

−

=

=

∑

∑Y

X2

r21y r2

2y r21y + r2

2yR2=

r12= 0X1

2.5.2. Bondad de ajuste.

( )( )

RSCSC

Y Y

Y Yy k

t

ii

N

ii

N. , ,..,exp

$

1 22

2

1

2

1

= =−

−

=

=

∑

∑Y

X1 X2

a bc

R=a+b+c

1-R2 r12≠ 0

r21y =a+c

r22y =b+c

2.5.3. Validación del modelo.

Fuentes de variación

Suma de Cuadrados

g.l Varianza F

Explicada o regresión

K

Residual N-K-1

Total N-1

( )$Y Yii

N

−=∑ 2

1SS

RK

RN K

res

y k

y k

exp

. , ,...,

. , ,...,

2

2

1 22

1 221

1

=−− −

SSC

Kexpexp2 =

SSC

N Kresres2

1=

− −( )Y Yi i

i

N

−=∑ $ 2

1

SSC

Ntt2

1=

−( )Y Yii

N

−=∑ 2

1

2.5.4. Significación de parámetros.

1) Planteamiento de hipótesis

H0: βj=0

H1: βj≠0

tbS

tbS

tbS

tbS

b

b

b

kk

bk

00

11

22

1

2

=

=

=

=

2) Estadístico de contraste

2.5.4. Significación de parámetros.

3) Región de rechazo4) Regla de decisión

Ejemplo:

Nivel de desarrollo a los 6 años

Estimulación paterna

Nivel de desarrollo a los 3 años

Estimulación materna 0,48

0,01

0,62

$ , , , ,Y X X Xi = + + +20 80 0 48 0 01 0 621 2 3

2.5.3. Validación del modelo.

Fuentes de variación

Suma de Cuadrados

g.l Varianza F

Explicada o regresión

557,12 3 185,71 274,05

Residual 40,66 60 0,68

Total 63

2.5.4. Significación de parámetros.

H0: βj=0

H1: βj≠0

tbS

tbS

tbS

tbS

b

b

b

00

11

22

33

3

20 82 70

7 69

0 480 051

9 342

0 010 034

0 421

0 620 02

25 56

1

2

= = =

= = =

= = =

= = =

,,

,

,,

,

,,

,

,,

,

Ejemplos de Regresión lineal múltiple con SPSS

Variables introducidas/eliminadas b

SEXO,mesesmonoparentalidad dehecho,competenciaescolar(Harter),Aceptaciónsocial

a

. Introducir

Modelo1

Variablesintroducidas

Variableseliminadas Método

Todas las variables solicitadas introducidasa.

Variable dependiente: Autoconcepto globalb.

Resumen del modelo

.546a .298 .261 .58789Modelo1

R R cuadradoR cuadradocorregida

Error típ. de laestimación

Variables predictoras: (Constante), SEXO, mesesmonoparentalidad de hecho, competencia escolar (Harter),Aceptación social

a.

( )R R

k RN kcorregida

2 2211

= −−− −

⎡

⎣⎢

⎤

⎦⎥

Bondad de ajuste

Coeficiente de correlación múltipe: yyky rR ˆ,..,3,2,1. =

Ejemplos de Regresión lineal múltiple con SPSS

Ejemplos de Regresión lineal múltiple con SPSS

ANOVAb

11.150 4 2.788 8.066 .000a

26.267 76 .34637.417 80

RegresiónResidualTotal

Modelo1

Suma decuadrados gl

Mediacuadrática F Sig.

Variables predictoras: (Constante), SEXO, meses monoparentalidad dcompetencia escolar (Harter), Aceptación social

a.

Variable dependiente: Autoconcepto globalb. Coeficientesa

1.388 .336 4.130 .000

.268 .095 .314 2.822 .006

.300 .113 .295 2.643 .010

.002 .002 .112 1.141 .257

.132 .136 .095 .968 .336

(Constante)competenciaescolar (Harter)Aceptación socialmesesmonoparentalidadde hechoSEXO

Modelo1

B Error típ.

Coeficientes noestandarizados

Beta

Coeficientesestandarizad

ost Sig.

Variable dependiente: Autoconcepto globala.

Varianza Explicada

Varianza residual tipErrorBt =

Ejemplos de Regresión lineal múltiple con SPSS

En el cuadro de coeficientes observamos que los coeficientes de regresión parcial de las variables monoparentalidad de hecho y sexo no son estadísticamente distintos de cero en consecuencia dichas variables deben eliminarse del modelo y volver a estimar la ecuación de regresión con las variables harter total y competencia escolar.

Este procedimiento de incluir todas las variables que el investigador considera relevantes en la explicación de la variable dependiente en SPSS se conoce como método “Introducir”. Es el investigador, una vez analizados estadísticamente los coeficientes estimados, el que debe depurar la ecuación eliminando las variables no significativas. Deben eliminarse una a una. Es decir en primer lugar eliminamos sexo y volvemos a estimar con las que quedan y si todas son significativas esa sería la ecuación válida. En cualquier otro caso habría que eliminar la siguiente no significativa. Este proceso acaba cuando todas las variables son estadísticamente significativas.

Para seleccionar las variables relevantes en un modelo de regresión se puede proceder como hemos comentado en el párrafo anterior o se pueden utilizar otros procedimientos. De los procedimientos disponibles para construir un modelo de regresión e implementados en SPSS comentaremos el de estimación “paso a paso” o “pasos sucesivos” porque junto al anterior es de los que más se utilizan en investigación.

2.7. Estimación paso a paso: correlación semiparcial al cuadrado(más información en:http://www.personal.us.es/vararey/adatos2/semiparcial.pdf)

Paso 1. Se estima una ecuación de regresión simple con la variable independiente tenga la mayor correlación con la variable dependiente:Paso 2. Se busca la variable independiente que disminuya más la proporción de variabilidad residual de la primera ecuación. Paso 3. Se recalcula la ecuación de regresión utilizando las dos variables independientes que mejor explican a la variable dependiente, y se examina el valor parcial F de la variable original del modelo para ver si todavía realiza una contribución significativa. Si no lo hace, se elimina. Si lo hace, la ecuación queda: Paso 4. Continua este procedimiento con todas las variables independientes restantes para ver si deberían incluirse en la ecuación. Si se incluye alguna, hay que examinar las variables previamente incluidas para juzgar si deben mantenerse.Vamos a utilizar el procedimiento de estimación “paso a paso” o “pasos sucesivos” para estimar la ecuación de regresión de la variable estrés total (emes_total) utilizando como variables independientes sexo, personal y competencia. Para utilizar este procedimiento en el cuadro de regresión lineal seleccionamos “pasos suc” en método.

22110ˆ XbXbbY ++=

110ˆ XbbY +=

2.7. Estimación paso a paso: correlación semiparcial al cuadrado

Resumen del modelo

,310a ,096 ,093 7,02505 ,096 31,751 1 298 ,000,379b ,144 ,138 6,84871 ,048 16,543 1 297 ,000

Modelo12

R R cuadradoR cuadradocorregida

Error típ. de laestimación

Cambio enR cuadrado Cambio en F gl1 gl2

Sig. delcambio en F

Estadísticos de cambio

Variables predictoras: (Constante), competenciaa.

Variables predictoras: (Constante), competencia, Sexob.

ANOVAc

1566,962 1 1566,962 31,751 ,000a

14706,705 298 49,35116273,667 2992342,923 2 1171,462 24,975 ,000b

13930,744 297 46,90516273,667 299

RegresiónResidualTotalRegresiónResidualTotal

Modelo1

2

Suma decuadrados gl

Mediacuadrática F Sig.

Variables predictoras: (Constante), competenciaa.

Variables predictoras: (Constante), competencia, Sexob.

Variable dependiente: emest_totalc.

Coeficientesa

26,771 2,402 11,147 ,000-,382 ,068 -,310 -5,635 ,000

29,241 2,419 12,089 ,000-,402 ,066 -,326 -6,061 ,000

-3,241 ,797 -,219 -4,067 ,000

(Constante)competencia(Constante)competenciaSexo

Modelo1

2

B Error típ.

Coeficientes noestandarizados

Beta

Coeficientesestandarizad

ost Sig.

Variable dependiente: emest_totala.

2.7. Estimación paso a paso: correlación semiparcial al cuadrado

De los resultados obtenidos con el procedimiento de estimación “paso a paso” comentaremos aquellos de la tabla Resumen del modelo que son nuevos con respecto a los obtenidos con el método “Introducir”. Como en el método anterior la primera tabla es:

Resumen del modelo

,310a ,096 ,093 7,02505 ,096 31,751 1 298 ,000,379b ,144 ,138 6,84871 ,048 16,543 1 297 ,000

Modelo12

R R cuadradoR cuadradocorregida

Error típ. de laestimación

Cambio enR cuadrado Cambio en F gl1 gl2

Sig. delcambio en F

Estadísticos de cambio

Variables predictoras: (Constante), competenciaa.

Variables predictoras: (Constante), competencia, Sexob.

En esta tabla en la columna Modelo los valores 1 y 2 corresponden a las ecuaciones estimadas en los dos pasos de la aplicación del método. En el paso 1 se estima la ecuación de regresión simple (modelo 1) con la variable competencia como predictora por que es la que tiene una correlación (R=0,310) mayor con la variable dependiente.En el paso 2 se ha estimado la ecuación de regresión múltiple con las variables competencia y sexo. De las dos variables independientes restantes: personal y sexo la que incrementa más la proporción de variabilidad explicada de Y es sexo por tanto esta se incluye y se excluye personal. La variable personal se ha excluido por no resultar significativa. En la Columna R cuadrado disponemos de la bondad de ajuste del modelo de regresión simple estimado en el paso 1

y que puede ser representada en un diagrama de Venn por el siguiente gráfico:

096,021 =yR Y

0,096

096,021 =yR

2.7. Estimación paso a paso: correlación semiparcial al cuadrado(más información en:http://www.personal.us.es/vararey/adatos2/semiparcial.pdf)

El segundo valor de la columna de R cuadrado es la bondad de ajuste del modelo de regresión múltiple final:

Como ocurre siempre la bondad de ajuste de la ecuación de regresión múltiple es mayor que la de la ecuación de regresión simple (0,144>0,096). La diferencia es el incremento en proporción de variabilidad explicada debido a la inclusión en el segundopaso de la variable sexo. Luego la variable sexo aporta a la variabilidad explicada de la variable dependiente:

a este incremento se le denomina coeficiente de correlación semiparcial al cuadrado y se le denota como

El diagrama de Venn correspondiente a la bondad de ajuste anterior sería:

144,0212. =yR

21

212.

2)1.2( yyy rRR −=

048,0096,0144,021

212. =−=− yy rR

096,021 =yR

048,02)1.2( =yR

Y

X1 X2

2.7. Estimación paso a paso: correlación semiparcial al cuadrado

La segunda parte de la tabla Resumen del modelo concretamente en la columna Cambio en R cuadrado de nuevo obtenemos la bondad de ajuste de la regresión simple

y el incremento en variabilidad explicada debida a la Inclusión de la variable sexo . Además, como para que una variable se incluya en la ecuación la variabilidad explicada tiene que ser estadísticamente significativa en la columna Cambio en F se calculan dichos valores para el modelo de regresión Simple y para el incremento debido a la variable sexo. La última columna corresponde a la significación de la F para la validación del modelo de regresión simple y para el incremento en variabilidad explicada debida a la variable sexo respectivamente. La siguiente tabla resume la información más importante que en la tabla Resumen del modelo nos proporciona el procedimiento de estimación paso a paso.

096,021 =yR

048,02)1.2( =yR

Paso Ecuación Bondad de ajuste F

1

2

Proporción de variabilidad explicada por:

X1

X1

X2

110ˆ XbbY +=

11 2

1

21

−−−

KNR

R

y

y21yR 2

1yR

21yR

11 2

12.

2)1.2(

−−−

KNR

R

y

y22110

ˆ XbXbbY ++= 212.yR

2)1.2(yR

2.7. Otro ejemplo de Regresión lineal múltiple con SPSS y estimación paso a paso

Resumen del modelo

,450a ,203 ,199 6,33162,508b ,258 ,251 6,12246,522c ,273 ,263 6,07258

Modelo123

R R cuadradoR cuadradocorregida

Error típ. de laestimación

Variables predictoras: (Constante), conflrol Conflicto derol

a.

Variables predictoras: (Constante), conflrol Conflicto derol, sobrecar Sobrecarga

b.

Variables predictoras: (Constante), conflrol Conflicto derol, sobrecar Sobrecarga, superesp Superespecialización

c.

Coeficientesa

4,913 1,159 4,240 ,000,183 ,024 ,450 7,679 ,000

2,350 1,280 1,836 ,068,123 ,027 ,303 4,519 ,000,135 ,033 ,277 4,138 ,000,559 1,510 ,371 ,711,089 ,031 ,220 2,872 ,004,159 ,034 ,326 4,655 ,000

,152 ,069 ,142 2,193 ,029

(Constante)conflrol Conflicto de rol(Constante)conflrol Conflicto de rolsobrecar Sobrecarga(Constante)conflrol Conflicto de rolsobrecar Sobrecargasuperesp Superespecialización

Modelo1

2

3

B Error típ.

Coeficientes noestandarizados

Beta

Coeficientesestandarizad

ost Sig.

Variable dependiente: emesttot emest_totala.

203,021 =yR

055,02)1.2( =yR

Y

X1

X2

X3

015,02)12.3( =yR

2.8. Términos de interacción en el modelo de regresión(más información en http://www.personal.us.es/vararey/adatos2/interaccion.pdf).

Interacción entre variables cualitativas

Interacción entre una variable cualitativa y una cuantitativa

Interacción entre variables cuantitativas

2.8. Interacción entre variables cualitativas: ausencia de interacción

y = 2,46x + 6,16

y = 2,46x + 4,08

0,00

2,00

4,00

6,00

8,00

10,00

12,00

0 1Motivación baja Motivación alta

Mujer (1)

Hombre (0)

Y:Rendimiento

X2:Motivación

X1:Sexo

( ) 1120

2

110

2

22110

ˆ1

ˆ0

ˆ

ii

ii

iii

XbbbY

XXbbY

XXbXbbY

++=

=

+=

=

++=

Sexo Motivación Coeficientes

0 (Hombre) 0 (Baja) 4,084,08 = b0

1 (Mujer) 0 ( Baja) 6,166,16-4,08 = 2,08 = b1

0 (Hombre) 1 ( Alta) 6,54 8,62-6,16 = 2,46 = b2

1 (Mujer) 1 (Alta) 8,62

( )motivasexoYY ,ˆ =

2.8. Interacción entre variables cualitativas

y = 2,5x + 14,71

y = -0,886x + 13,356

0

5

10

15

20

25

0 1

turno

conf

licto

fijo variable

Implicación alta (1)

Implicación baja (0)

Y: ConflictoX1:Turno

X2: Implicación

X1X2

Variable Moderadora

Y: ConflictoX1:Turno

X2: Implicación

( ) ( )

( ) ( ) 131202

1102

1231220

21322110

21322110

ˆ)(1

ˆ)(0

ˆ

ˆ

ii

ii

iiii

iiiii

iiiiii

XbbbbYAltaXXbbYBajaX

XXbbXbbY

XXbXbXbbY

eXXbXbXbbY

+++==+==

+++=

+++=

++++=

2.8. Interacción entre variables cualitativas

Matriz de DatosResumen del modelo

,838a ,702 ,677 1,22845Modelo1

R R cuadradoR cuadradocorregida

Error típ. de laestimación

Variables predictoras: (Constante), X1xX2 interacción,X2 implicación, X1 turno

a.

ANOVAb

128,017 3 42,672 28,277 ,000a

54,327 36 1,509182,344 39

RegresiónResidualTotal

Modelo1

Suma decuadrados gl

Mediacuadrática F Sig.

Variables predictoras: (Constante), X1xX2 interacción, X2 implicación,X1 turno

a.

Variable dependiente: conflictob.

Coeficientesa

14,710 ,388 37,867 ,0002,500 ,549 ,585 4,551 ,000

-1,354 ,549 -,317 -2,465 ,019-3,386 ,777 -,687 -4,358 ,000

(Constante)X1 turnoX2 implicaciónX1xX2 interacción

Modelo1

B Error típ.

Coeficientes noestandarizados

Beta

Coeficientesestandarizad

ost Sig.

Variable dependiente: conflictoa.

2.8.Interacción entre variables cualitativas

Coeficientesa

14,710 ,388 37,867 ,0002,500 ,549 ,585 4,551 ,000

-1,354 ,549 -,317 -2,465 ,019-3,386 ,777 -,687 -4,358 ,000

(Constante)X1 turnoX2 implicaciónX1xX2 interacción

Modelo1

B Error típ.

Coeficientes noestandarizados

Beta

Coeficientesestandarizad

ost Sig.

Variable dependiente: conflictoa.

212121322110

21322110

386,3354,15,271,14ˆ XXXXXXbXbXbbY

eXXbXbXbbY

iiiii

iiiiii

−−+=+++=

++++=

( ) ( ) ( ) ( ) 1113120

2

1110

2

886,0356,13386,35,2354,171,14ˆ)(1

5,271,14ˆ)(0

XXXbbbbY

AltaXXXbbY

BajaX

ii

ii

−=−+−=+++=

=

+=+=

=

2.8.Interacción entre variable una variable cualitativa y una cuantitativa

y = 0,5984x + 83,282

y = -1,4016x + 53,282

0

20

40

60

80

100

-6 -4 -2 0 2 4 6 8

edad en diferenciales (centrada)

CI t

otal

sin ansiedad con ansiedad

Y: CItotalX1:Edad

X2: Ansiedad

X1X2

Variable Moderadora

( ) ( )( ) ( )( )

( )( ) ( )( )1131202

11102

11231220

2113221110

ˆ)(1

ˆ)(0

ˆ

ˆ

XXbbbbYansiedadConXXXbbYansiedadSinX

XXXbbXbbY

XXXbXbXXbbY

ii

ii

−+++==−+==

−+++=

−++−+=

Y: CITotalX1:Edad

X2: ansiedad

2.8. Interacción entre una variable cualitativa y una cuantitativa

Matriz de Datos

Estadísticos descriptivos

48 6,00 18,00 10,8750 3,5045648

edadN válido (según lista)

N Mínimo Máximo Media Desv. típ.

Resumen del modelo

,969a ,939 ,935 4,10700Modelo1

R R cuadradoR cuadradocorregida

Error típ. de laestimación

Variables predictoras: (Constante), interaccion,ansiedad, edaddif

a.

ANOVAb

11471,415 3 3823,805 226,697 ,000a

742,169 44 16,86712213,584 47

RegresiónResidualTotal

Modelo1

Suma decuadrados gl

Mediacuadrática F Sig.

Variables predictoras: (Constante), interaccion, ansiedad, edaddifa.

Variable dependiente: citb.

2.8. Interacción entre dos variables cuantitativas

Variable Moderadora

Y: IntenciónX1:Actitud

X2: Presión

X1X2

Y: IntenciónX1:Actitud

X2: Presión

( ) ( ) ( )( )( )( ) ( )( )( )1122312220

221132221110

ˆ

ˆ

XXXXbbXXbbY

XXXXbXXbXXbbY

i −−++−+=

−−+−+−+=

2.8. Interacción entre una variable cualitativa y una cuantitativa

Coeficientesa

83,282 ,838 99,342 ,000,598 ,241 ,130 2,478 ,017

-30,000 1,186 -,940 -25,304 ,000-2,000 ,341 -,308 -5,857 ,000

(Constante)edaddifansiedadinteraccion

Modelo1

B Error típ.

Coeficientes noestandarizados

Beta

Coeficientesestandarizad

ost Sig.

Variable dependiente: cita.

( ) ( )

( )

( ) ( )( ) ( )1111

2

11

2

211211

40,128,532598,030282,83ˆ)(1

598,0282,83ˆ)(0

230598,0282,83ˆ

XXXXY

ansiedadConXXXY

ansiedadSinXXXXXXXY

iii −−=−−+−=

=−+=

=−−−−+=

2.8. Interacción entre dos variables cuantitativas

Matriz de Datos

Estadísticos descriptivos

125 1,00 5,00 3,0000 1,41990125 1,00 5,00 3,0000 1,41990125

actitudpresionN válido (según lista)

N Mínimo Máximo Media Desv. típ.

Resumen del modelo

,968a ,938 ,936 1,43740Modelo1

R R cuadradoR cuadradocorregida

Error típ. de laestimación

Variables predictoras: (Constante), interacción,presiondif, actituddif

a.

ANOVAb

3750,000 3 1250,000 605,000 ,000a

250,000 121 2,0664000,000 124

RegresiónResidualTotal

Modelo1

Suma decuadrados gl

Mediacuadrática F Sig.

Variables predictoras: (Constante), interacción, presiondif, actituddifa.

Variable dependiente: intenciónb.

2.8. Interacción entre dos variables cuantitativas

( ) ( ) ( )( )( )( ) ( )( )( )112222

22112211

13211ˆ12311ˆ

XXXXXXY

XXXXXXXXY

−−−+−−=

−−−−−−+=

Coeficientesa

11,000 ,129 85,560 ,0003,000 ,091 ,750 33,000 ,000

-2,000 ,091 -,500 -22,000 ,000-1,000 ,064 -,354 -15,556 ,000

(Constante)actituddifpresiondifinteracción

Modelo1

B Error típ.

Coeficientes noestandarizados

Beta

Coeficientesestandarizad

ost Sig.

Variable dependiente: intencióna.

presión b0 b1

-2 15 5

-1 13 4

0 11 3

1 9 2

2 7 1

y = 5x + 15

y = 4x + 13

y = 3x + 11

y = 2x + 9

y = x + 7

0

5

10

15

20

25

30

-3 -2 -1 0 1 2 3actitud en diferenciales

inte

nció

n

presión -2 presión -1 presión 0 presión 1 presión 2

Para terminar: Multicolinealidad

Uno de los problemas más graves que podemos encontrarnos a la hora de construir un modelo de regresión es el de la multicolinealidad que tiene que ver con la elección de variables independientes o predictoras altamente correlacionadas. Cuando esto ocurre podemos tener un modelo válido y ningún coeficiente de regresión significativo. Esto se debe a que, en presencia de colinealidad, los errores estándar son muy grandes y los coeficientes inestables. Para detectar multicolinealidad podemos utilizar diferentes índices dos de los más frecuentes e implementados en los paquetes estadísticos son el factor de inflación de varianza (FIV) y el índice de condición (IC). Respecto al factor de inflación de la varianza (FIV) se sugiere como regla que ningún FIV sea mayor que 4 (otros autores sitúan el valor de FIV en 10). En cuanto al índice de condición se considera que valores mayores que 30 indican multicolinealidadalta, entre 10 y 30 moderada y menos de 10 baja.

![4>) ') IUTZGIZUX - CHINT · :nk xkrgzo\k n[sojoz_ ynu[rj tuz k^ikkj gz znk [vvkx zksvkxgz[xk rosoz ul - ' nomnkx xkrgzo\k n[sojoz_ oy grru]kj gz g ru]kx zksvkxgz[xk k m gz - 9vkiogr](https://static.fdocumento.com/doc/165x107/6131395d1ecc5158694499c2/4-iutzgizux-chint-nk-xkrgzok-nsojoz-ynurj-tuz-kikkj-gz-znk-vvkx.jpg)

![6(6,Ï1 - UGRfmocan/MATERIALES CURSO/GUION SESION2.pdf · u v } _ ] / xk x h v ] À ] ' v 6(6,Ï1 2emhwlyrv 5hvxplu rughqdu \ dqdol]du frqmxqwrv gh gdwrv](https://static.fdocumento.com/doc/165x107/5f6ec1c2b05c274ce627748f/661-fmocanmateriales-cursoguion-sesion2pdf-u-v-xk-x-h-v-.jpg)